画像の解釈と解析

はじめに

取得した衛星画像を適切に読み取り解析をしなければ、衛星画像は空の上から撮影された単なる写真と大差がありません。衛星画像の解釈・解析の作法を学び、画像を読み解くことで、私たちは有益な情報を取得することができます。

1. 画像解釈の基礎

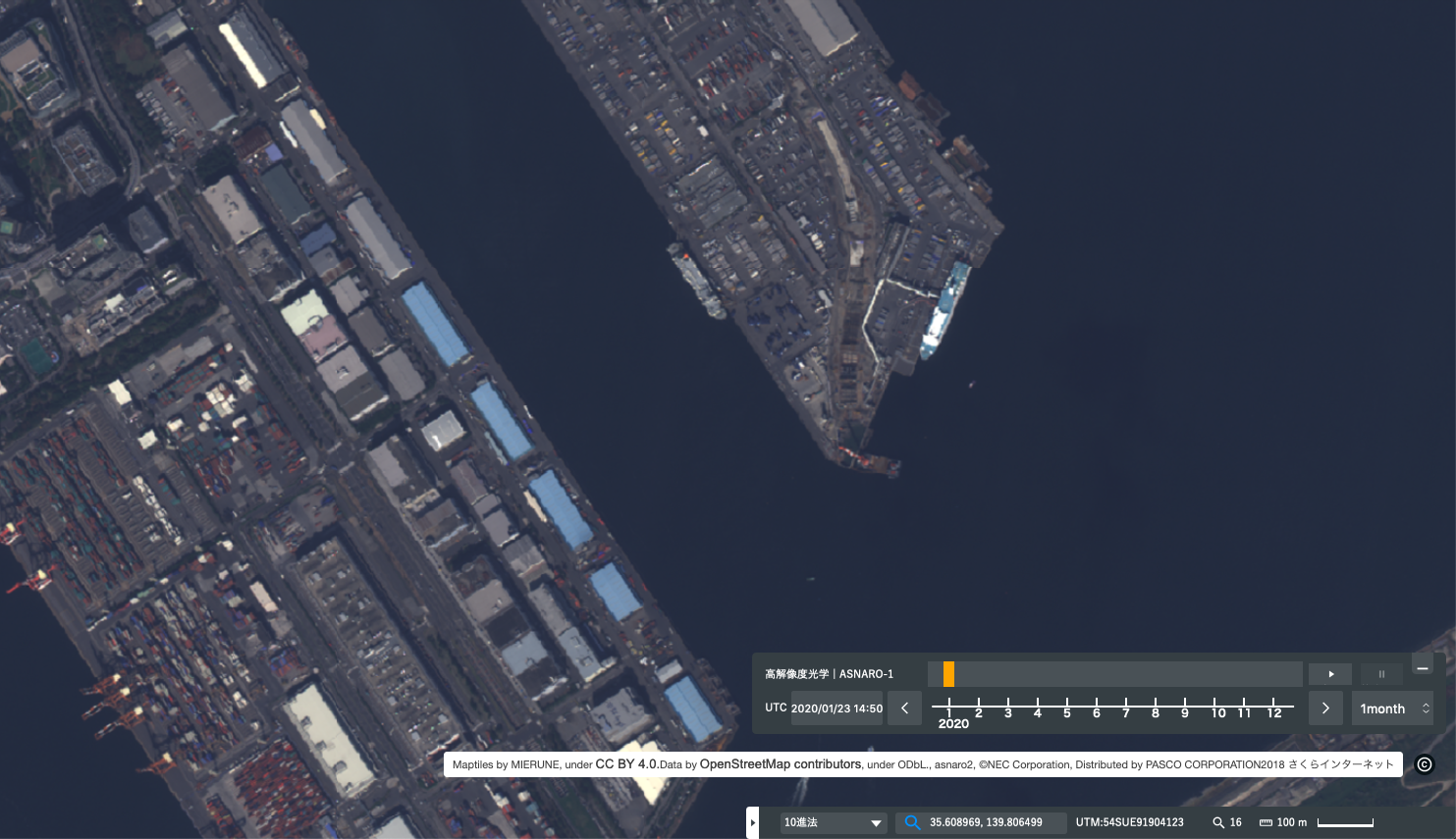

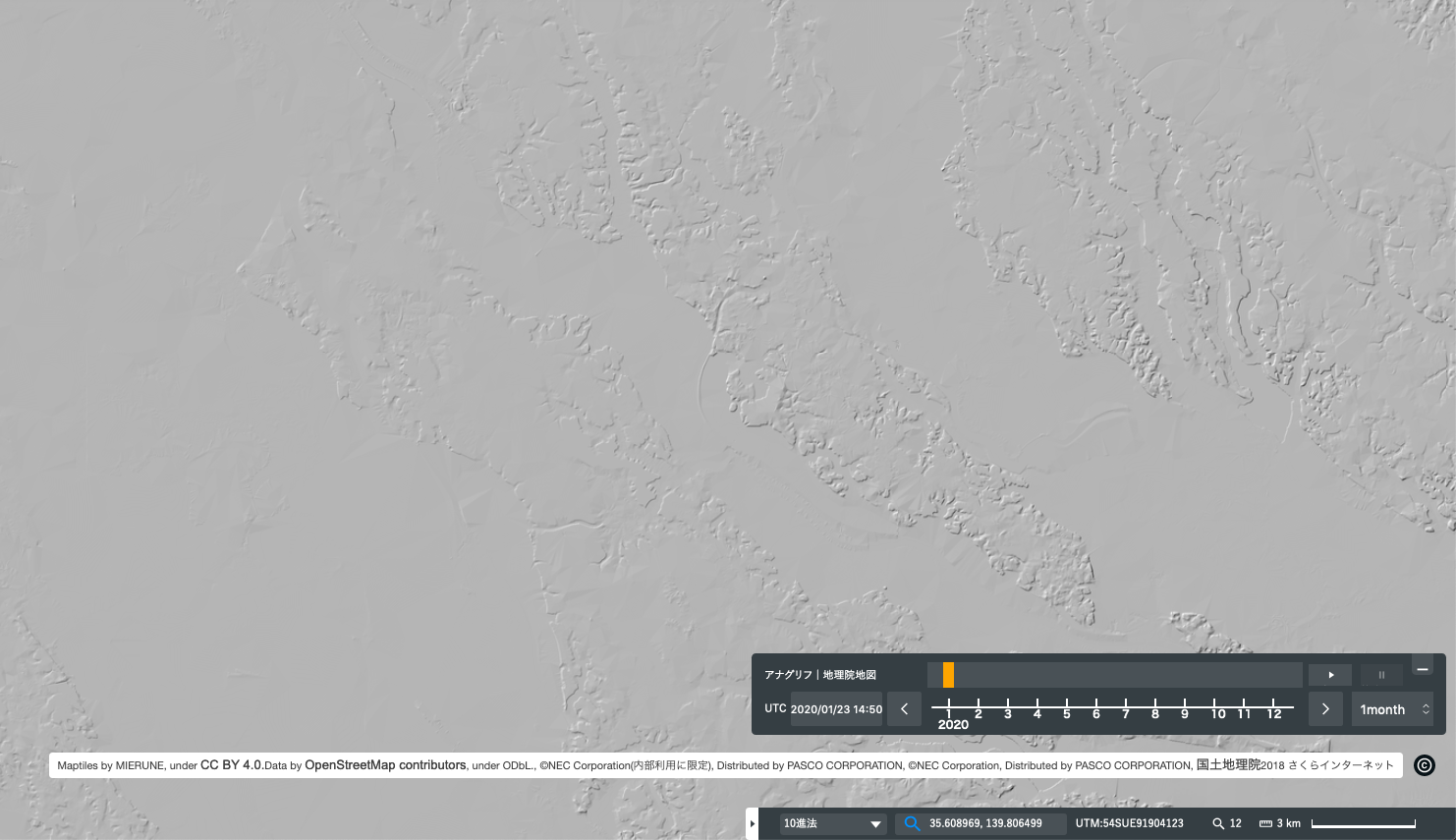

衛星画像を解釈するということは、異なる対象物の視覚的要素である色調、形、サイズ(スケール)、パターン、テクスチャ、影、そして連想性(関連性)といった要素を捉えることにあります。

色調(Tone):色調は画像の鮮やかさ(brightness)、もしくは色に言及するもの。色調は様々な対象物、もしくは異なった地物(feature)を区別する基本的な要素となります。

形(Shape):形状は各々の対象物の構造、もしくはアウトラインを示します。直線的な形状は人工物の典型であり、家屋や田畑が該当します。一方で自然物はより形状が複雑なものになります。

サイズもしくはスケール(Size or Scale): 画像内での対象物の大きさは、現実でどの程度の大きさなのかを見積もる上で重要となります。

パターン(Pattern):パターンとは対象物の空間配置を表したもの。似た色調やテクスチャの繰り返しは、特定の地物として判別可能なパターンとなることがあります。

テクスチャ(Texture):テクスチャは画像内の特定領域における色調変化の配分や頻度を表したものです。粗いテクスチャは小さい範囲で色調が劇的に変化するため、まだら模様で構成されます。一方で滑らかなテクスチャでは色調の変化は非常に乏しく、のっぺりとした面で表現されます。

影(Shadow):影は対象物の高さに関する情報を提供する一方で、その影で別の対象物を隠してしまうことがあります。

連想性(Association):連想性とは対象物とその近傍の物体や地物の間にある関連性を示します。他の地物との繋がりを考えることは、対象物の解釈を助けることになります。例えば埋立地においては大規模商業施設、工業地帯、コンテナ、広い道路などといったものが連想されます。

2. デジタル画像処理

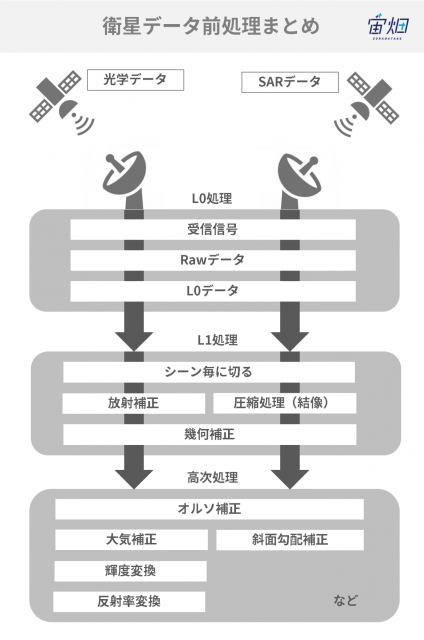

前処理:放射量補正、もしくは幾何補正を含み、主要な解析の前に行われます。最初の過程であるL0処理とは、衛星からデータを受信して最初に行う処理のことです。L0処理の中を詳しく見ていくと、

1. 衛星からの電波を地上のアンテナで受信する

2. 受信信号は伝送向けに加工が行われているので、元の信号(Rawデータ)に戻す

3. Rawデータから余計な情報を削ぐ(L0データ)

というステップとなっています。L0段階での衛星データは一般的の人たちが触ることはほとんどないデータであり、衛星を所有する企業・期間で行われる処理だと考えてください。

・ 画像補正:画像の見栄えを改善するものであり、画像の解釈や解析を助けます

・ 画像変換(Image transformation):算術的処理(和・差・積・商)を行い、各バンドから得られたオリジナルデータを一枚の画像に結合することです。また主成分分析といった高度な計算を通すことにより、ハイパースペクトルデータ内の「余分な」情報を省き、効率的に画像を描写できます

・ 画像分類・解析:画像分類は「教師なし画像分類」、「教師あり画像分類」、「オブジェクトベース画像解析(Object-based Image Analysis(OBIA)」に分類されます

3. 前処理

・ 前処理とは、センサーやプラットフォーム由来の放射的・幾何的(radiometric and geometric)データの歪みを補正し、現実のシーンにより近いデータへと変換をすることです。

・ 前処理は一般的にRadiometricもしくはGeometric補正で分類されます。

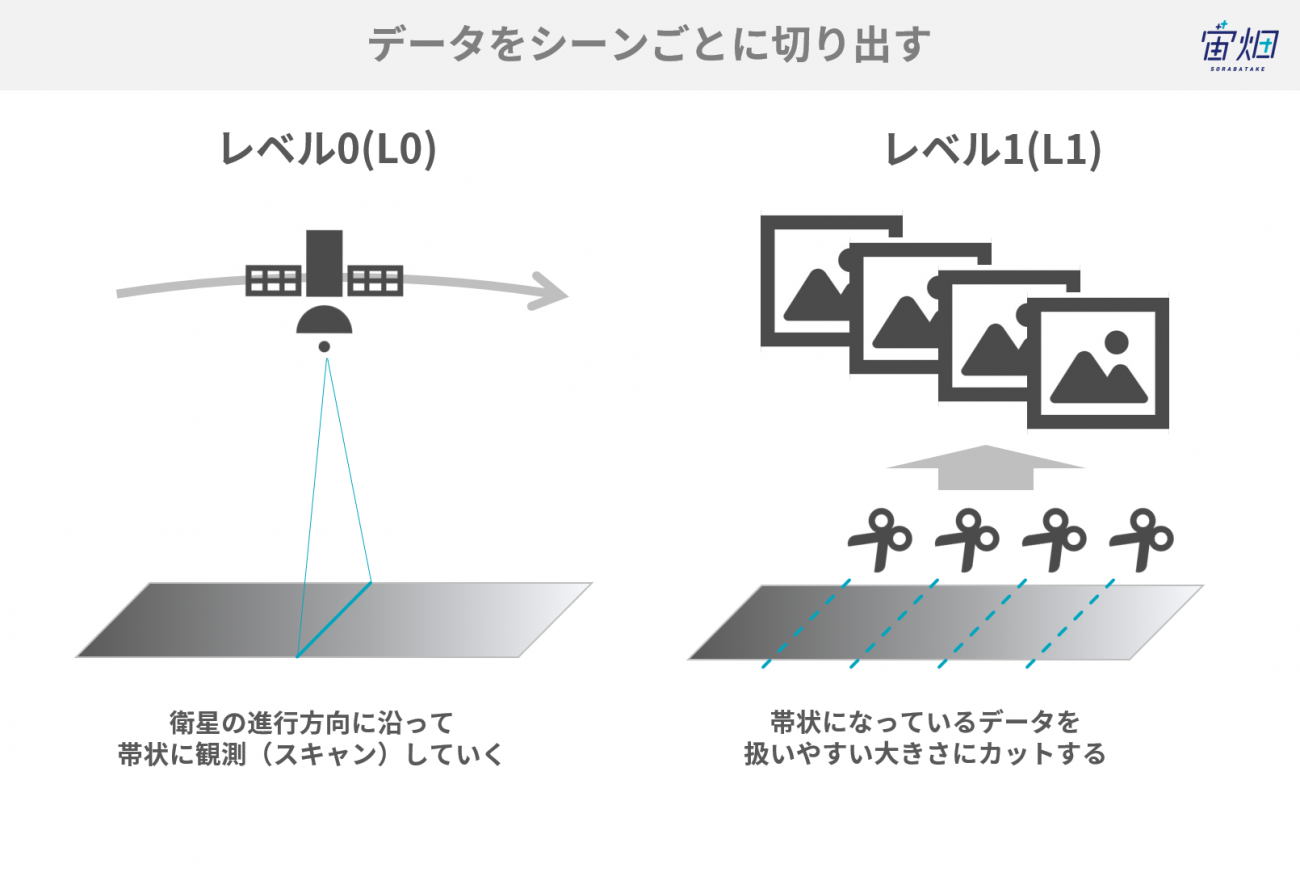

ここでは特にL1処理について言及しています。L1処理は大きく、

1. シーン毎の切り出し

2. 画像の感度調整/結像して絵にする

3. 画像の歪みの除去

の3段階に分けられます。

衛星は進行方向に地上をスキャンしたデータを持っています。このままでは扱いづらいデータであるため(データ容量の問題など)、データを適切と考えられる大きさに小さくします。これがデータをシーンごとに切り出すという作業になります。

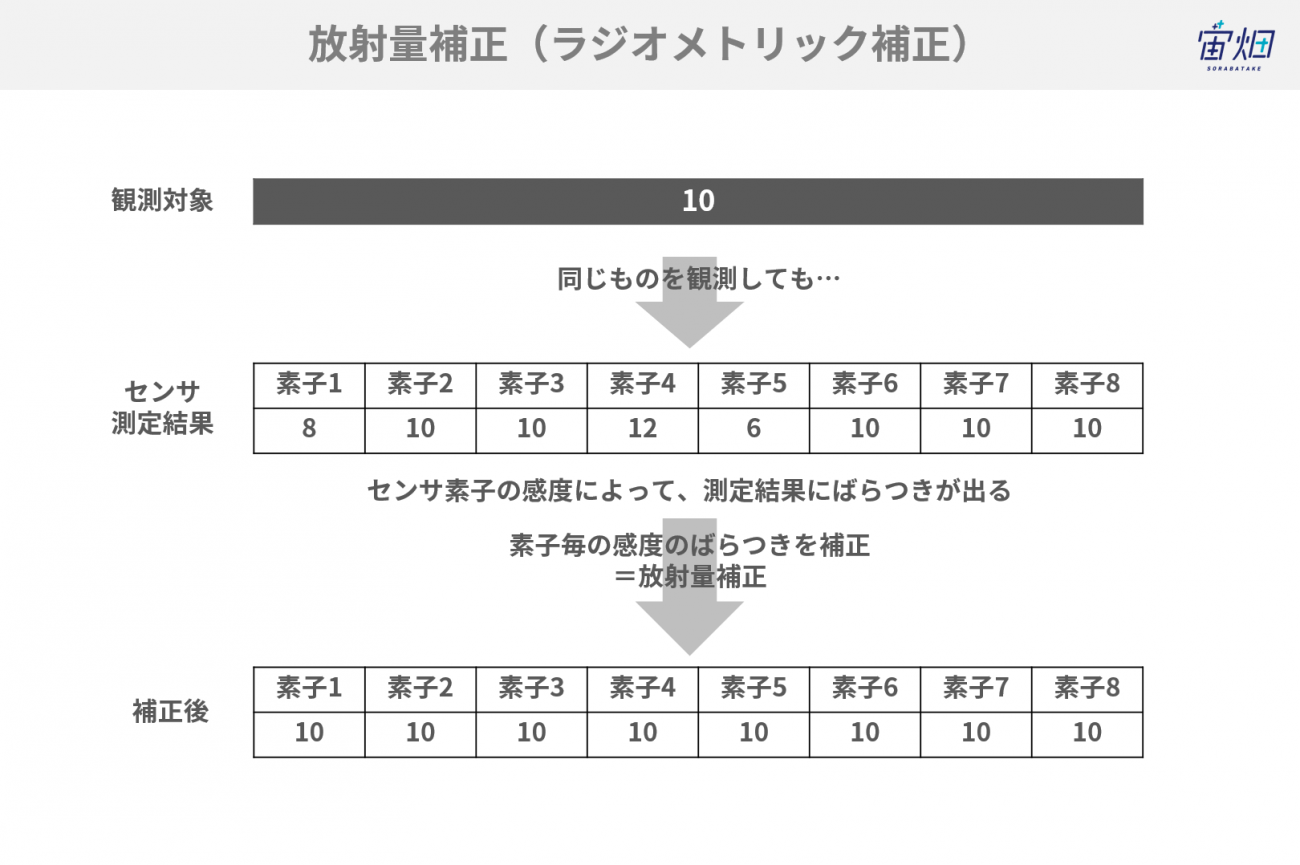

続いて行う処理が放射量補正というものです。圧縮補正とはセンサーやプラットフォーム由来、または大気中のノイズを補正し、センサーによって計量された反射されたエネルギーや放射されたエネルギーを正確に示すことです。簡単に言ってしまうと、画像を綺麗にする作業となります。

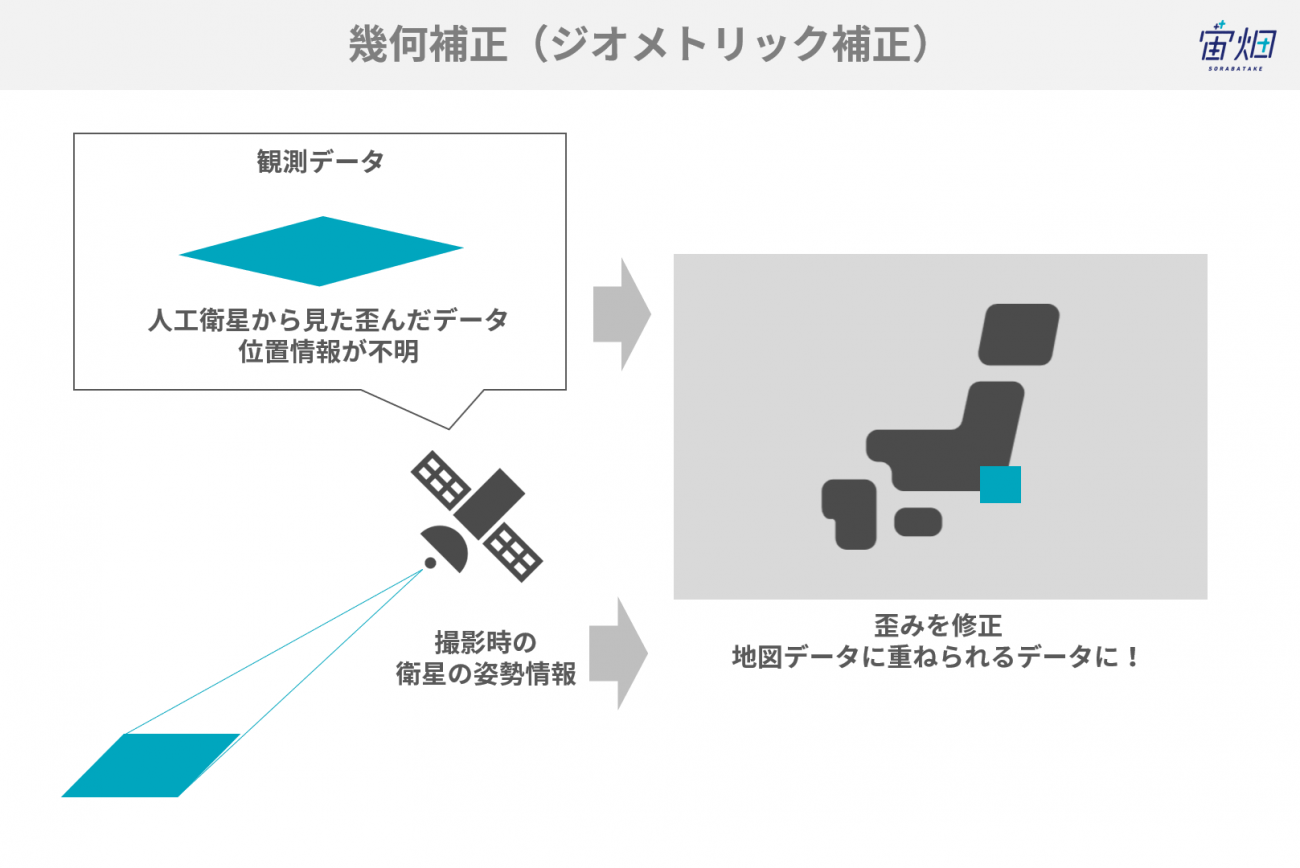

幾何補正とはセンサーと地球の幾何的な変化によって引き起こされる幾何的な歪みを補正することであり、データを地球表面の座標に置き換えていくことです(きちんと地図に重なるように変形させるということ)。

歪みの原因としては、

・ 標高の変化

・ センサの高さや撮影速度

・ 地球の曲率

・ 大気の屈折

・ 画像の歪み(Relief displacement)

・ IFOVセンサーの移動における非線形性(nonlinearities in the sweep of a sensor’s IFOV)

が考えられます。

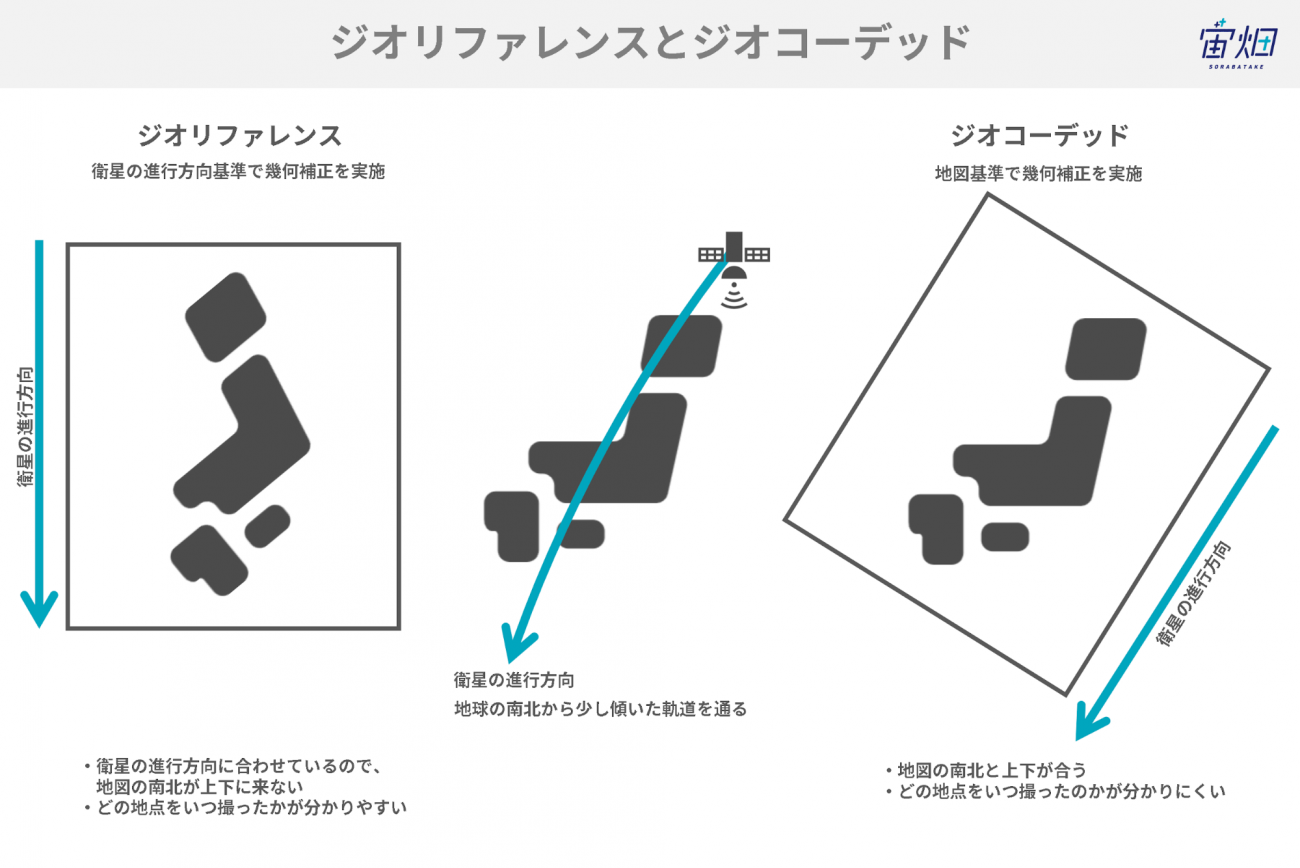

幾何補正で画像を地図の上に重ねていく、その方法にも2種類があります。

・ Georeferencing:画像を実際の座標へと適切に変換するための計算

・ Geocoding:画像のすべてのピクセルが地形上の座標系へと正しく配置すること

4. 後処理

リサンプリング

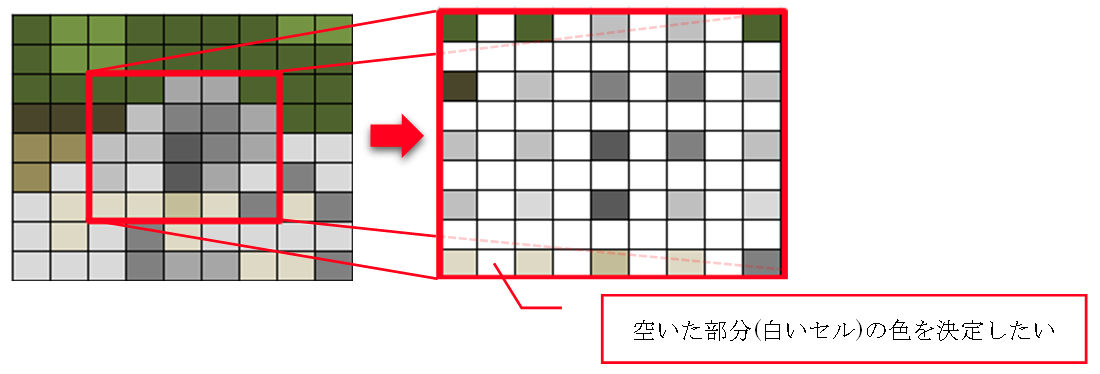

オリジナル画像のピクセル値から新しいピクセルの値を計算することをリサンプリングと呼びます。リサンプリングは後処理において、画素を地図投影に合わせて再配置するときに行われるものです。GISで用いるラスターデータは各々のセルの中に色情報をもった写真と同じようなものですが、全てのセルが正確な値をもっているわけではありません(「空の」画素があるとも言えます)。そのため、正確な色情報を基準にして空白のセルを埋める必要があります。

*https://www.esrij.com/gis-guide/imagery/resampling/から引用した図

計算の手法には最近隣内挿法(Nearest neighbourhood)、共一次内挿法(bilinear interolation)、三次たたみ込み内挿法(Cubic convoltion)という代表的なものがあります。

最近隣内挿法(Nearest neighbourhood):

・ Nearest neighbourリサンプリングでは、結果の画像とインプット画像(オリジナル)のピクセル座標で近い位置のピクセル値を参照します

・ 元のピクセル値を変えませんが、いくつかのピクセル値は重複し、欠損してしまうことがあります

・ この方法ではスペクトルの情報が他の手法に比べて正確であり、スペクトル分野を扱う場合に適しています。また、正確なピクセル情報を重視する科学分野においても多用される計算方法でもあります

出典:https://www.brockmann-consult.de/beam/doc/help/general/ResamplingMethods.html

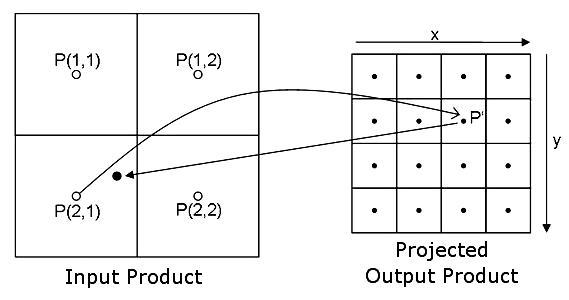

双一次内挿法(Bi-linear interpolation):

・ 右側の図(リサンプリングしたい結果のラスターデータ)のピクセル値の位置(P’)に最も近い4つのピクセルをインプット画像から選び、それらの重み付き平均値をとります

・ この手法では、オリジナルのピクセル値は変化し、完全に新しいピクセル値をもった画像を作成することになります

・ P’(x,y) = P(1,1)(1-d)(1-d’)+P(1,2)d(1-d’)+P(2,1)d’(1-d)+p(2,2)dd’でピクセル値は求められます

出典:https://www.brockmann-consult.de/beam/doc/help/general/ResamplingMethods.html

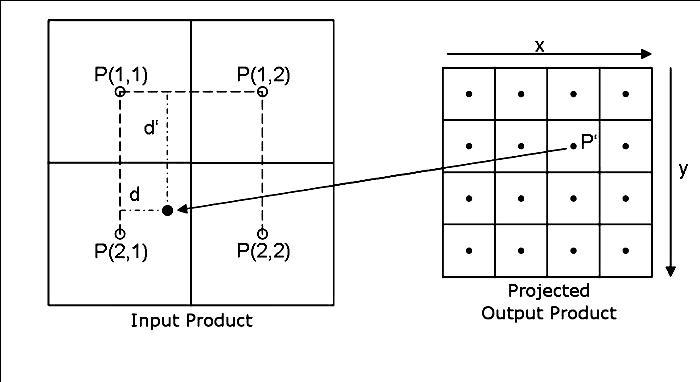

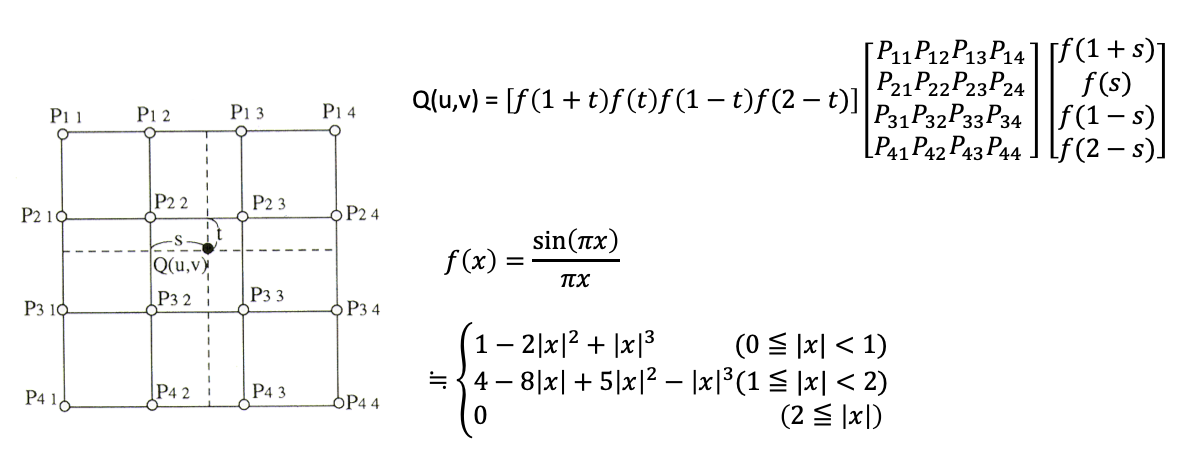

三次たたみ込み内挿法(Cubic convolution):

・ 補正された画像のピクセル値に近いところから、16個のピクセルをオリジナルのイメージから選択、それらの重み付き平均をとります

・ 画像中のエッジは、bi-linearより鮮明になります

*xはリサンプリングする点の座標(u,v)と、インプット画像のピクセルの位置(i,j)の差

出典:http://wtlab.iis.u-tokyo.ac.jp/wataru/lecture/rsgis/rsnote/cp9/cp9-7.htm

この時Q(u,v)はリサンプリングするポイント、Pijはインプット画像のピクセル位置となっています。

Image enhancement

Image enhancementは、画像の編集をして、より見やすい画像へと変化させること。多くの増強効果は、オリジナルのデータを歪めることに繋がります。

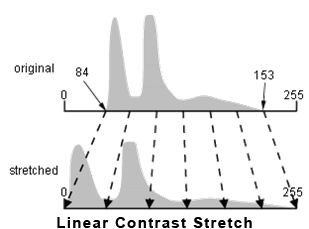

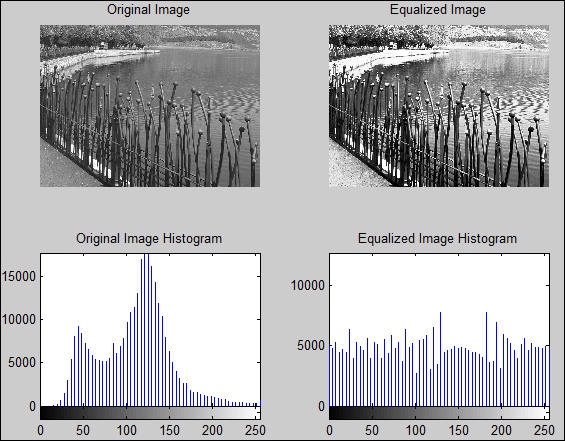

コントラストエンハンスメント:

・ コントラストエンハンスメントでは対象物とその背景間のコントラストを増加させることも含みます

・ コントラストエンハンスメントの理解にはimage histogram(画像のヒストグラム)のコンセプトを理解することが重要となります

・ イメージヒストグラム(mage histogram)とは、画像を構成する値の鮮やかさを表したヒストグラムです

・ Linear contrast stretchでは、データからヒストグラムを作成し、下限と上限を求める。この範囲をデータとしての最小値と最大値まで引き延ばします(RGBでは0が最小、255が最大値となる)

出典:http://gis.humboldt.edu/OLM/Courses/GSP_216_Online/lesson4-2/radiometric.html

Histogram-equalized stretchでは、元のデータから得られたヒストグラムをLinear contrast stretchのように、単に最小値と最大値へと引き延ばすのではなく、計算を通して平らなヒストグラムへと変化させます

出典:https://subscription.packtpub.com/book/hardware_and_creative/9781849697200/2/ch02lvl1sec24/histogram-equalization-for-contrast-enhancement

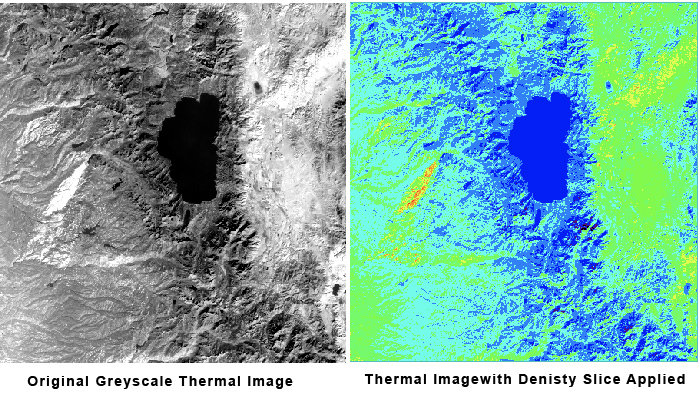

Density slicing:

・ イメージヒストグラムのx軸上に分布しているデジタル値を特定の間隔に分割します

・ 各々の区分(スライス)に色が割り当てられます。

・ この手法は一つのバンド情報しか持たないような画像に対して用いられます。例えば白黒のサーマールイメージにおいて、温度が摂氏2度の間隔で区分されたとすれば、各々の区分に応じて配色がされることになります。これにより温度の情報は黒と白で見る以上に理解がしやすくなります。

出典:http://gis.humboldt.edu/OLM/Courses/GSP_216_Online/lesson4-2/radiometric.html

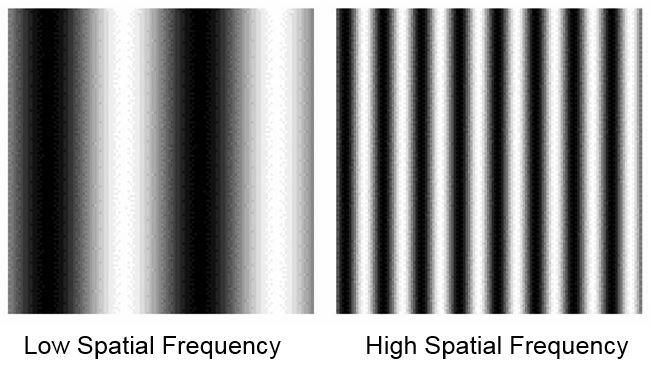

Spatial filtering:

・ 空間的な頻度(spatial frequency)に基づいて、画像内の特定の事物を強調したり、抑制したりすることです。

・ Spatial frequencyはイメージ中で色調における変化の頻度を表します。

・ 「粗い」テクスチャでは色調は小さいエリアの中で劇的に変化します。この場合、spatial frequenciesは高くなる一方で、「滑らか」であれば、spatial frequenciesは低くなります

出典:http://gsp.humboldt.edu/olm_2016/courses/GSP_216_Online/lesson4-2/spatial.html

出典:http://gsp.humboldt.edu/olm_2016/courses/GSP_216_Online/lesson4-2/spatial.html

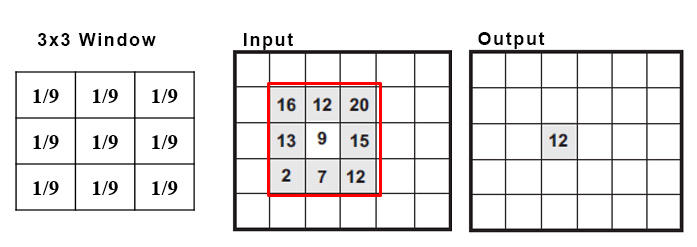

Low pass filters:「近隣」の高い値や低い値を平均化し、外れ値を均す方法です。Low pass filtersはノイズ除去や、局所的な変化を抑制するために用いられます。アウトプットされるピクセル値は、その周辺に存在するピクセル値によって得られた係数を乗ずることによって得られています。この手法は畳み込み(convolution)と言われるものの一つです。

画像分類と解析

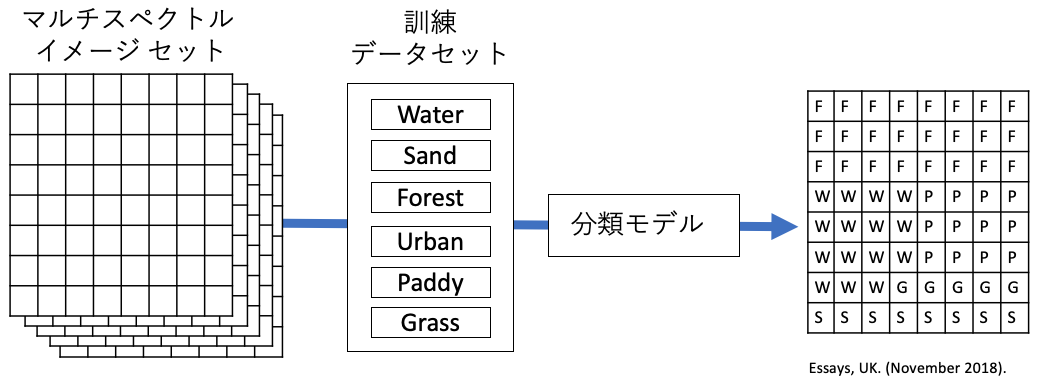

画像分類とは、画像に含まれる特徴的な情報に基づき、統計的な手法などを用いて画像を分類することです。画像分類とは、大きく教師なし画像分類と教師あり画像分類があります。

教師なし画像分類:教師なし画像分類では、

1. クラスターを生成する

2. クラスに当てはめる

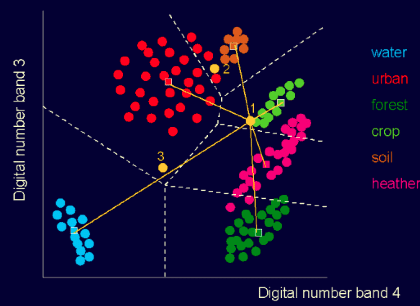

という手順に従うことになります。例えばISODATA(Iterative Self-Organizing Data Anaysis)では、スペクトル距離を用いて繰り返しピクセルをクラスタリングするという手法です。教師なし分類では値は分類されますが、分類されたものが何であるかの判断を与えることはありません。例えば植生と非植生を分類した後、植生を表すクラスターとしてどちらが妥当かについては解析者自身が決定をしなければならないということです。そのため解析した人は対象地に対する知識を有していなければ、正確にクラスターに意味づけをすることが難しくなります。

教師あり画像分類:

3つの基本ステップがあります。

1. 訓練データを選択する(エリアの選択)、Signature fileの生成

2. 分類する

3. 結果の出力

画像の中からクラスを代表する最適なものを抽出し訓練データとします。例えば、水、砂、森、都市、耕作地、草地で分類すると考えましょう。集めた訓練データはシグネチャファイル(signature file)としてまとめられます。集めたシグネチャファイルを用いて、対象となる画像から、最尤法やSVM(Support Vector Machine)などのアルゴリズムに従いクラス分類がされることになります。

(1) 訓練:最適なトレーニングアリアを定め、クラスとしての基準になるスペクトル情報を取得します。これらの情報は訓練データとして分類モデルを作成する際に用いられます。

(2) 分類:画像の中の全てのピクセルが上で決定したクラスへとモデルに従い分類されます。仮にピクセル値がどのクラスにも属さないと判断されれば、分類不可とラベリングされる場合もあります。

(3)出力: 結果の出力は地図上に示される他、表として示される場合もあります。

教師あり・教師なし分類はピクセルベース分類ですが、OBIAでは画像分割アルゴリズムを用いてグループ化されたピクセルをベクターに変換します。得られたオブジェクトは、スペクトル・空間的な尺度によって分類をされます。

OBIAでは、

・ 分割(segmentation)では画像を実際の地物の特徴を捉えたオブジェクトに分割します。

・ 分類(classification)は形状、サイズ、空間的・スペクトル的属性を用いて、分割したオブジェクトを分類します。

という意味を持ちます。

参考文献

・ Digital Image Processing | Natural Resources Canada

・ Image Classification Techniques in Remote Sensing

・ Digital Image Classification | GEOG 480: Exploring Imagery and Elevation Data in GIS Applications

・ Digital Image Calssification

・ How to Interpret a Satellite Image: Five Tips and Strategies